港大經管學院學者帶領國際研究團隊進行大數據分析 了解在自然災害下與家人及朋友的通訊行為

港大經管學院市場學副教授賈軾教授所帶領的研究團隊近日在國際頂級期刊《自然*通訊》發表研究論文,通過流動數據分析人們在應急情況下與家庭和朋友的通訊行為。

人在面對極端環境下會向個人社交網絡成員求助,是一種重要的求生技能。然而,在危機及災害下的親屬及社交網絡所採取的應對方面,現時卻只有極少數相關的實證研究。賈軾教授的研究團隊運用35,565名地震災民的不記名流動通信數據資料,研究了人們在面對7級地震時與家人及非家人的聯絡及通訊,在現有的社交網絡理論—嵌入性(Embeddedness)上注入嶄新概念,從而解釋個人在災後的通訊行為。是次的研究主要分析人們在地震發生多久後使用流動電話、聯絡的對象、聯絡的人數以及對話中的溝通及互動。

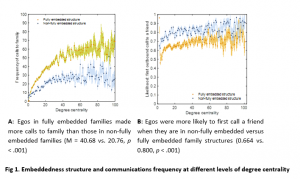

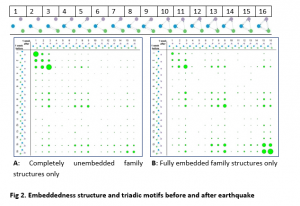

研究運用了社交網絡中一個名為「嵌入性」的重要概念,並以嵌入性作為量度單位提出一個全新的結構。傳統的結構嵌入度概念提出擁有共同朋友的數量能影響人與人之間的關係,嵌入度越高代表他們之間的關係具有更高的信任度 。例如,夫妻之間擁有共同的好友越多,他們之間的婚姻關係就越穩定。賈教授團隊進一步將網絡嵌入性的研究從二元關係(人與人之間的關係)擴展到三元結構(Triadic embeddedness structure),即以同一家庭中的三人與其他成員相互之間的關係作研究作為更有效的量度方式,深入分析了各種嵌入結構如何影響地震後人們的應急通訊行為。

賈軾教授的團隊發現,在越高的地震強度下,那些具有完整嵌入性結構(即家庭成員之間擁有其他的共同好友)的家庭會在更短的時間內聯繫家人。而在災害發生後的數周內,高嵌入性的人在其家庭內部的通訊也表現出更多的互動性,而且他們與核心家庭之外的社會網路成員間也會有更多通訊。整體而言,嵌入性愈高的家庭表現出更佳的內部溝通及互動,並擁有更強的朋友社交網絡。

是次的研究為災後的溝通情況及社會行為作出全新的詮釋。儘管現時已有不少關於社交網絡的研究,但大都只基於正常平穩的生活條件下進行,並未包括自然災害等突如其來的緊急情況。時至今日,環境上的改變亦為世界帶來不少的衝擊。在2004 – 2013年的10年間,已有6,525宗災害記錄,包括3,867宗自然災害,引致過百萬人的死亡以及超過1兆美金的經濟損失。雖然是次的研究為自然災害,與疫症不盡相同,但研究團隊期望新冠肺炎疫情能喚起更多災後社會狀況的研究及政策關注,從而幫助社會在後疫情時代盡快適應及復甦。

Jia, J.S., Li, Y., Lu, X. et al. Triadic embeddedness structure in family networks predicts mobile communication response to a sudden natural disaster. Nature Communications 12, 4286 (2021). https://doi.org/10.1038/s41467-021-24606-7

如有興趣進一步瞭解該項研究,請參閱《自然*通訊》網址: https://www.nature.com/articles/s41467-021-24606-7,文章下載: https://rdcu.be/cogG3。

圖1. 在不同網路中心度下,嵌入結構對家庭成員通訊頻率的影響(左圖)以及震後首先給朋友打電話的可能性(右圖)

| A: 非嵌入家庭結構演化情況 | B: 完全嵌入家庭結構演化情況 |

圖2. 地震前後不同嵌入結構對三元網路演化狀態的影響(圈的大小表示出現頻率)